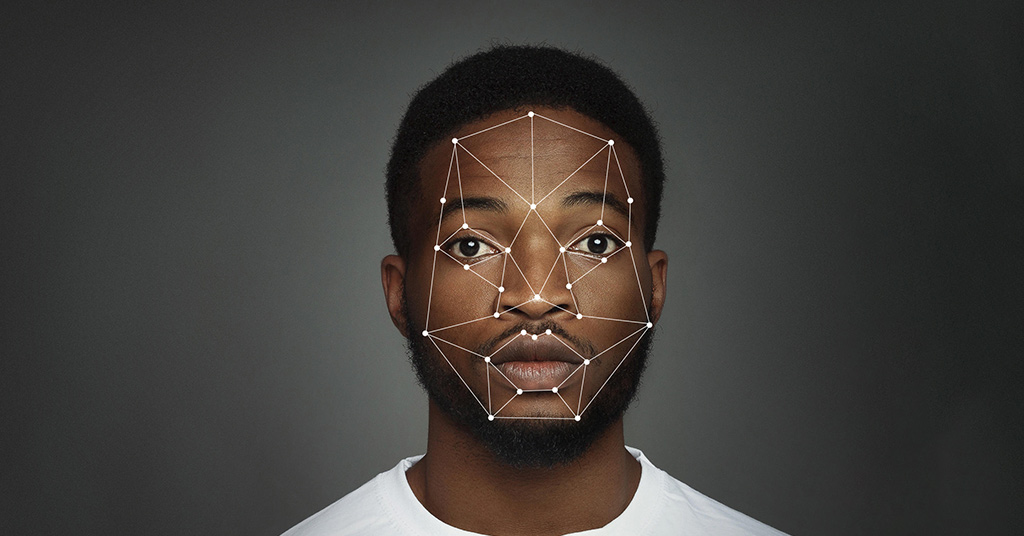

В США оценили работу систем распознавания лиц

Многие системы распознавания лиц часто ошибочно идентифицируют темнокожих людей. Такими данными поделилось правительство США по результатам недавнего исследования Национального института стандартов и технологий. Для отчета NIST протестировал 189 алгоритмов от 99 разработчиков. Исследование показало, что при сопоставлении лиц в базах данных, многие алгоритмы неверно идентифицируют афроамериканцев и азиатов.

Погрешнсть случается в 10-100 раз чаще, чем в случе с людьми кавказской внешности.

Также проблемы с идентификацией часто возникникают у афроамериканок, особенно в случае применения алгоритма сопоставления одного фото со множеством других лиц. Именно такой метод применяется в уголовном расследовании.

Исследование проводилось на фоне растущего недовольства технологией распознавания лиц в Соединенных Штатах. Критики предупреждают, что некорректная работа систем идентификации может привести к несправедливым преследованиям или арестам.

Результаты исследования оказались хуже, чем можно было предположить.